BTC/HKD+1.44%

BTC/HKD+1.44% ETH/HKD+0.99%

ETH/HKD+0.99% LTC/HKD+1.1%

LTC/HKD+1.1% ADA/HKD+2.92%

ADA/HKD+2.92% SOL/HKD+1.33%

SOL/HKD+1.33% XRP/HKD+4.11%

XRP/HKD+4.11%3月29日,非營利組織“未來生命研究所(Future of Life Institute)”發表了一封題為“暫停巨型AI實驗”的公開信,呼吁全球的AI實驗室暫停訓練比GPT-4更強大的系統至少6個月,并在此期間開發出一份針對AI的共享安全協議,必要時需要政府介入。

1000多名科技人士在這份公開信上簽名,包括特斯拉CEO馬斯克、Stability AI 的CEO Emad Mostaque等企業掌門人,也包括Alphabet旗下DeepMin的研究人員,還有諸如圖靈獎得主Yoshua Bengio這樣的重量級學者。當然,也有人表達了不同意見,認為這是在阻礙技術進步。

開發出GPT-4模型的OpenAI公司內還沒有人簽名,該公司目前也沒有對這封公開信予以回應。但我們向卷入紛爭中的ChatGPT要了個回應。

這個AI自然語言大模型產品倒是表現出了善解人意的一面:暫停實驗存在合理性,但需要謹慎考慮這么做帶來的技術發展滯后問題。它還給出了關于AI的六大風險和十個管理制度建議。

人類精英:暫停實驗 確立規則

截至今日,掛在“未來生命研究所(FLI)“官網上的《暫停巨型AI實驗》公開信,已經收集了1130人的簽字,名單里精英云集,不乏特斯拉、蘋果等科技公司的高管,也有政客和作家,當年,更多的是全球多所高校的教授以及人工智能領域的專家。??????

呂廷杰:區塊鏈技術成為了影響人類文明的5大顛覆性技術之一:5月30日下午,北京郵電大學經濟管理學院院長、清華五道口全球金融科技項目授課師資呂廷杰教授在清華大學五道口金融學院云課堂聯合每經智享會推出的“五道口在線大講堂”上表示,區塊鏈技術成為了影響人類文明的5大顛覆性技術之一,銀行業也可以將區塊鏈應用作為轉型的方向。[2020/5/31]

那么精英云集簽字的這封公開信到底說了什么?以下是這封信的全文(向上滑動啟閱)

廣泛的研究表明,具有能與人類競爭的智能的AI系統會對社會和人類構成深刻的風險,頂尖的AI實驗室也承認這一點。正如廣受認可的阿西洛馬人工智能原則(Asilomar AI principles)原則所述,高級AI可能代表著地球生命歷史的深刻變化,應該以合適的態度和資源去進行規劃和管理。不幸的是,這種水平的規劃和管理并沒有發生。盡管最近幾個月AI實驗室陷入了一場失控的競賽,以開發和應用越來越強大的數字思維,然而沒有人能夠理解、預測或可靠地控制這些思維,甚至他們的創造者也不能。

當代AI系統在一般任務上正在擁有與人類競爭的能力,我們必須問問自己:

我們應該讓機器在我們的信息渠道中充斥宣傳和謊言嗎?

聲音 | 泰康保險集團創始人:區塊鏈等把人類社會帶到了一個數據的時代:金色財經報道,泰康保險集團創始人、董事長兼CEO陳東升演講表示,今天互聯網、人工智能、區塊鏈、大數據、云計算,把人類社會帶到了一個數據的時代。[2019/11/27]

我們是否應該自動化所有的工作,包括那些有成就感的工作?

我們是否應該培養出可能比我們數量更多、比我們更聰明、最終超越并取代我們的非人類思維?

我們是否應該冒著失去對我們文明控制的風險?

此類決策決不應該委托給未經選舉產生的技術領導人。只有當我們確信AI的效果是積極的,風險是可控的時候,AI系統才應該被開發。這種對AI的判斷必須是合理的,并隨著系統潛在影響的變化而變化。

OpenAI最近關于人工通用智能(AGI)的聲明指出,“在開始訓練未來的系統之前,進行獨立審查可能很重要。同時對于最前沿的工作而言,人們應該在合適的時間點限制用于創建新系統的計算增長率。我們同意這一說法,并認為現在就是合適的時間點。

因此,我們呼吁所有的AI實驗室立即暫停訓練比GPT-4更強大的AI系統至少6個月。這種暫停應該是公開的和可核實的,所有關鍵的參與者也能暫停相關工作。如果這種暫停不能迅速開始,政府應該介入并實施暫停。

聲音 | Tim Draper:比特幣對人類有益,美國監管機構應給予其發展空間:美國風險投資家Tim Draper接受采訪時表示,比特幣對人類有益,美國聯邦監管機構應該給它空間來蓬勃發展。隨著Facebook的Libra遭受來自各方的抨擊,比特幣也被置于聚光燈下,Draper表示,更多的曝光率整體來說對比特幣是有好處的:“這讓一切都得以顯現。讓人們談論比特幣是件好事,因為他們談論得越多,就會越意識到比特幣對全世界、對我們所有人的重要性。” 這位經驗豐富的科技投資者表示,加密貨幣或可降低交易成本,并使國際支付更加便利,從而使人類受益。Draper稱,“這于我們來說是最好的事情之一。”(CNBC)[2019/7/20]

AI實驗室和獨立專家應利用這一暫停的時段,共同開發一套AI設計和開發的共享安全協議,這些協議需要由獨立的外部專家嚴格審計和監督。這些協議應確保所有遵守它們系統的AI是安全的。這種暫停并不意味著總體上暫停AI開發,只是讓人們從具有新興功能的、不可預測的危險競賽中后退一步。

AI的研究和開發應該重新聚焦于使當今強大、最先進的系統更加準確、安全、可解釋、透明、穩健、一致、可信和可靠。

與此同時,AI開發人員必須與政策制定者合作,大幅加快強大的AI管理制度的開發。管理制度至少應包括以下內容:

聲音 | Vlad Zamfir:以太坊明顯缺乏有效控制和人類參與:據newsbtc報道,以太坊基金會首席研究員Vlad Zamfir認為,以太坊明顯缺乏有效控制和人類參與,以及存在遵守Szabo定律的傾向。Zamfir反對Szabo規定的協議改進或改變技術維護的想法。他認為,“代碼即法律”(Code is Law)的看法是用詞不當,是“過于徹底的反法律,以至于不適合作為合理加密合法制度的一部分”。因此,他仍然反對區塊鏈所代表的自治。[2019/3/21]

?針對AI的新的、有能力的監管機構;

?監督和跟蹤能力強大的AI系統和計算能力池;

?幫助區分真實和合成數據的溯源、水印系統,并跟蹤模型泄露;

?提供健全的審計和認證生態系統;

?對AI造成的損害進行責任認定;

?為AI技術的安全研究提供充足的公共資金;

?資源充足的機構以應對AI將造成的巨大經濟和破壞(尤其是對民主的破壞)。

人類可以通過AI享受一個繁榮的未來。在成功創建了強大的AI系統后,我們現在可以享受一個“AI之夏”。

人類基因組項目之父計劃利用區塊鏈出售基因信息:麻省理工學院教授、“人類基因組項目”之父喬治·切奇(George Church)稱希望將基因信息放在區塊鏈之上,用戶可以選擇自行出售自己的數據。[2018/2/11]

在這個AI的夏天,我們可以收獲回報,為所有人的利益設計這些系統,并給社會一個適應的機會。人類社會曾經暫停使用一些可能會對社會造成災難性影響的技術,我們現在也可以在AI領域這樣做。讓我們享受一個漫長的AI之夏,不要在沒有準備的情況下匆忙進入秋天。

事實上,這封公開信是近期人類精英們對人工智能風險擔憂的總爆發。自 ChatGPT 高速迭代后,擔憂從未停止,特別是當微軟、谷歌、百度、華為等科技巨頭們在自然語言模型上展開“軍備競賽”之后。

日前,“深度學習之父”杰弗里·辛頓(Geoffrey Hinton)在媒體采訪中表示,人工智能正處于“關鍵時刻”,毀滅人類“并非不可能”。AI領域內的“大牛”蓋瑞·馬庫斯(Gary Marcus)發推特支持辛頓,甚至發出靈魂一問:“用百分之一的人類毀滅風險換取和機器對話帶來的樂趣,這值得嗎?”

而馬庫斯在轉發FLI這封公開信時表示,“這封信并不完美,但精神是正確的。我們需要放慢腳步,直到我們更好地理解AI帶來后果……他們可能會造成嚴重傷害……主要參與者對他們正在做的事情越來越保密,這使得社會很難抵御可能發生的任何傷害。”

也有科技圈人士對這封信的觀點持不同意見。

Writer的創始人Waseem 以諷刺的語氣表達了他對權威們的不滿,“讓我們停止建設和發展我們的公司,因為來自硅谷的億萬富翁說我們有風險。一定要喜歡那些比我們人類更聰明的人,因為他們告訴我們如何生活。當我們有他們神圣的指引時,誰還需要進步?”

OSS Capital的創始人Joseph Jacks 態度更是簡潔明了:強烈反對,絕對不簽這個。

ChatGPT:暫停合理但小心阻滯技術

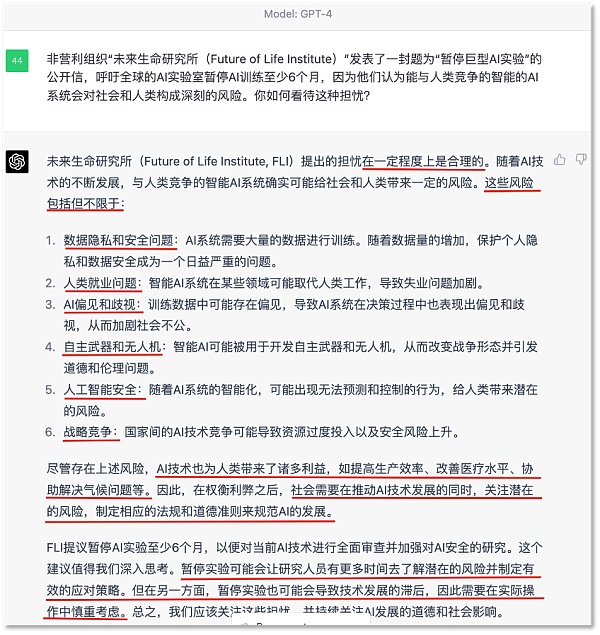

目前,OpenAI 還沒有就 FLI 的這封公開信做出回應。而我們把人類精英們的擔憂與建議甩給了ChatGPT,引發這場紛爭的這個對話機器人不但認可了FLI要求暫停實驗的合理性,還補充了六大AI風險。

ChatGPT的答案中也包含了暫停實驗帶來弊端:導致技術發展的滯后。這也和輿論場上很多普通大眾的想法趨同。????????????????????

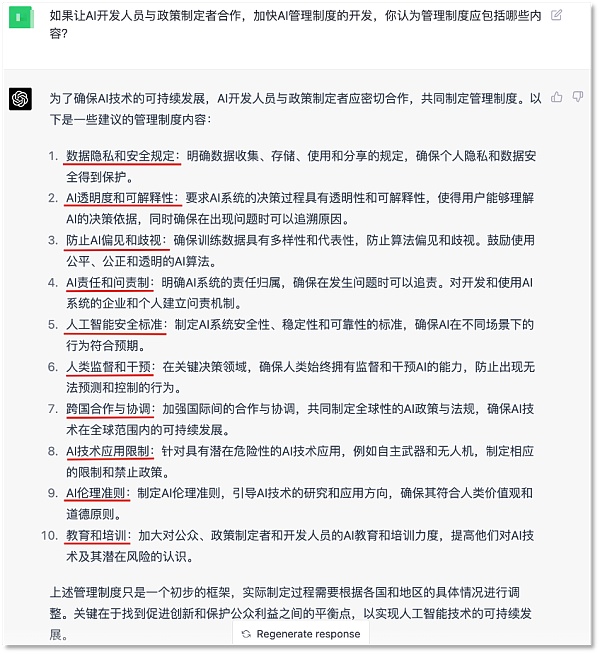

那么,問題擺在眼前,如果要讓研究人員和政府制定規則,該包含哪些內容呢?ChatGPT給出了十大建議,相當于給包括自己在內AI發展畫了一個規范圈。

連ChatGPT自己都這么說了,可見,“AI失控”、”替代人類“無論是在意見領袖圈層還是輿論場上都有探討的意義。

最近,微軟的創始人比爾·蓋茨在大力肯定人工智能帶來生產力提升的同時,也強調過風險,“AI失控的可能性是存在的,一臺機器會認為人類是自己的威脅嗎?它們會得出結論認為自身利益與人類的利益不同進而不在意我們嗎?” 他預測,隨著算法、算力的提升,超級智能AI會在未來出現。

連 OpenAI 的CEO Sam Altman都表示,超級智能AI的風險可能會遠遠超出我們的預料。此前,他在技術研究員Lex Fridman的播客中表達他的擔憂,包括AI造成的虛假信息問題,帶來的經濟沖擊等等,“危害可能遠遠超過了人類能應對的程度”,他舉了個例子,“我們怎么會知道,大語言模型沒有在推特上指揮大家的思想流動呢?”

這正應了那封公開信中所說的:沒有人能夠理解、預測或可靠地控制這些數字思維,“甚至他們的創造者也不能”。

雖然通用人工智能(AGI)還遠遠沒有到來,但就像比爾·蓋茨說得那樣,在這之前,世界需要建立規則以使AI帶來的正面影響遠遠超過其負面影響。

換句話說就是,別讓人類造出的東西把人類自己滅了。畢竟,戰爭、核事故帶來的災難還歷歷在目。

蜂巢Tech

個人專欄

閱讀更多

金色財經 善歐巴

金色早8點

白話區塊鏈

歐科云鏈

Odaily星球日報

Arcane Labs

MarsBit

深潮TechFlow

BTCStudy

鏈得得

上一篇重點把元宇宙賽道中的 VR 流派做了個梳理。如果上一篇分析的是元宇宙里的硬框架,這一篇就是元宇宙里的軟實力:與內容生成和場景搭建相關的 UGC,PGC 和 AIGC.

1900/1/1 0:00:00過去幾天,比特幣 (BTC) 市場的轉賬量大幅增加,處理的交易數量增加了 153%。這種活動的增加引起了加密分析師的注意.

1900/1/1 0:00:00文/Blockworks Research,譯/金色財經xiaozouBlockworks Research對AIP-1(Arbitrum Improvement Proposal F.

1900/1/1 0:00:00● 一部分基礎工作可能會被AI產品替代,然而,創意工作、管理和科研工作者等領域難以被取代,機器不可能像牛頓和愛因斯坦一樣做出顛覆性的發現.

1900/1/1 0:00:00最近,加密研究員 Thor Hartvigsen 總結了過去 30 天內一些知名風險投資基金、大型投資者以及交易員在加密貨幣市場上的活動.

1900/1/1 0:00:00編輯:liurui@Web3CN.Pro21世紀最讓打工人窒息的任務非“房貸”莫屬,房價被炒至遠遠大于產品本身的價值,但有且僅有房子能夠滿足人們的居住需求.

1900/1/1 0:00:00